No coração da corrida tecnológica, uma disputa silenciosa tenta decidir se a inteligência artificial vai reproduzir a lógica do mercado ou incorporar algum valor moral sobre a vida animal.

Num encontro discreto em São Francisco, ativistas e pesquisadores passaram a discutir não como usar inteligência artificial para vender mais, mas como fazê-la levar os animais em conta.

A aposta é ambiciosa porque parte da ideia de que os sistemas mais poderosos do futuro poderão influenciar decisões centrais da economia, da ciência e da política.

Se isso acontecer, a briga decisiva deixa de ser apenas por desempenho técnico e passa a ser por valores.

Foi essa a premissa do Sentient Futures Summit, realizado em fevereiro, que reuniu uma ala muito particular do Vale do Silício. Em vez de concentrar sua energia apenas em fazendas industriais, matadouros ou campanhas de consumo, esse grupo passou a olhar para os laboratórios de inteligência artificial como novo campo de batalha.

A pergunta que organiza esse movimento é simples, mas tem implicações enormes. Se máquinas cada vez mais capazes forem treinadas para orientar escolhas humanas ou tomar decisões diretamente, o que exatamente elas considerarão importante, digno de proteção ou moralmente irrelevante?

Constance Li, fundadora da Sentient Futures, resumiu essa visão ao MIT Technology Review. “A IA vai ser muito transformadora e vai basicamente virar o tabuleiro do jogo”, disse, antes de acrescentar que, se esses sistemas vierem a tomar a maioria das decisões, importa profundamente como eles valorarão os animais e outros seres sencientes.

A base filosófica desse campo vem, em grande parte, do altruísmo eficaz, corrente filantrópica que tenta maximizar o bem produzido por cada dólar investido. Trata-se de uma abordagem utilitarista que já provocou controvérsias ao defender, em certos casos, a priorização de sofrimentos futuros em escala gigantesca em vez de problemas imediatos e visíveis.

Quando essa lógica é aplicada ao mundo animal, ela produz conclusões que soam estranhas para muita gente fora desse círculo. Há quem sustente, por exemplo, que insetos e camarões merecem atenção especial porque existem em números tão vastos que mesmo uma pequena capacidade individual de sofrer poderia resultar, no agregado, em uma massa colossal de dor.

É nesse ponto que a inteligência artificial entra como instrumento e também como objeto da disputa moral. Jasmine Brazilek, cofundadora da Compassion in Machine Learning, apresentou no evento um benchmark criado para medir como grandes modelos de linguagem raciocinam sobre bem-estar animal.

A proposta dela é treinar esses modelos com documentos sintéticos que expressem preocupação com a vida animal. Nas palavras de Brazilek, a esperança é que futuros sistemas superinteligentes levem em consideração interesses não humanos.

O avanço dessa agenda também responde a um momento de frustração com soluções tecnológicas que, até pouco tempo atrás, pareciam mais promissoras para reduzir o sofrimento animal. A transição alimentar em massa perdeu fôlego, ações de empresas de carne vegetal como a Beyond Meat despencaram e leis contra a carne cultivada em laboratório avançaram em estados americanos.

Nesse cenário, a inteligência artificial aparece para esses ativistas como uma nova fonte de energia política e operacional. A expectativa não é apenas ganhar eficiência em tarefas rotineiras, mas abrir uma frente de influência sobre a arquitetura moral de tecnologias que podem reorganizar setores inteiros da sociedade.

Há planos bastante concretos nesse campo emergente. Alguns participantes querem usar assistentes de código baseados em inteligência artificial para automatizar programação e acelerar projetos ligados à causa animal.

Outros especulam sobre o uso de ferramentas como o AlphaFold, da DeepMind, para baratear caminhos de produção de carne cultivada em laboratório por meio do estudo de estruturas de proteínas. Mesmo quando essas aplicações ainda estão no terreno da hipótese, elas mostram como parte do ativismo animalista passou a enxergar a inteligência artificial não só como ameaça ou moda, mas como infraestrutura estratégica.

Mas o tema que mais mobilizou conversas no encontro foi menos técnico e mais material: dinheiro. Há a percepção de que uma nova onda de financiamento pode estar prestes a alcançar organizações voltadas ao bem-estar animal, e essa onda viria não dos doadores tradicionais, mas dos profissionais enriquecidos pela própria corrida da inteligência artificial.

Lewis Bollard, diretor do fundo para bem-estar animal da Coefficient Giving, descreveu esse deslocamento com clareza. Segundo ele, essa área foi historicamente negligenciada por grandes filantropias tradicionais, como a Fundação Gates e a Ford, e foram sobretudo pessoas da tecnologia que se mostraram mais abertas a financiá-la.

A própria Coefficient Giving é sustentada por Dustin Moskovitz, cofundador do Facebook, e por sua esposa, Cari Tuna, dois bilionários do Vale do Silício associados ao altruísmo eficaz. Isso ajuda a explicar por que o ecossistema da tecnologia, mais do que o circuito filantrópico clássico, passou a ser visto como o principal celeiro de recursos para esse tipo de agenda.

Na leitura de Bollard, a próxima geração de grandes doadores pode sair diretamente dos laboratórios de inteligência artificial. Ele destaca especialmente funcionários da Anthropic, empresa responsável pelo Claude, cuja equipe fundadora mantém vínculos com o universo do altruísmo eficaz e cuja estrutura interna inclui um programa generoso de doações combinadas.

Em fevereiro, a avaliação da Anthropic chegou a 380 bilhões de dólares. A empresa também ofereceu aos funcionários a possibilidade de converter parte de suas ações em dinheiro, o que alimenta a expectativa de que uma fração relevante desse capital possa migrar para organizações de defesa animal.

Esse detalhe financeiro revela algo maior do que uma simples mudança de patrocinadores. A riqueza concentrada pela revolução da inteligência artificial está formando uma nova elite filantrópica, com referências morais próprias, linguagem própria e uma visão de futuro moldada pela cultura do Vale do Silício.

Essa elite não quer apenas financiar produtos, empresas e pesquisa aplicada. Ela também demonstra disposição para influenciar a resposta a uma pergunta muito mais profunda: o que sistemas inteligentes devem valorizar quando forem chamados a organizar prioridades, distribuir recursos ou aconselhar decisões humanas?

É aí que o debate deixa de ser excêntrico e passa a ser politicamente relevante. Quando grupos privados, altamente capitalizados e ideologicamente coesos começam a disputar a ética de tecnologias transformadoras, a questão já não é apenas técnica, mas de poder.

Enquanto isso, em boa parte do Sul Global, a conversa sobre inteligência artificial costuma ficar presa à regulamentação defensiva, ao medo do desemprego ou à posição passiva de quem apenas reage ao que foi decidido em outros centros. Esse foco não é irrelevante, mas se torna insuficiente diante de uma disputa que já avançou para o terreno da programação moral e da definição de quais vidas contam.

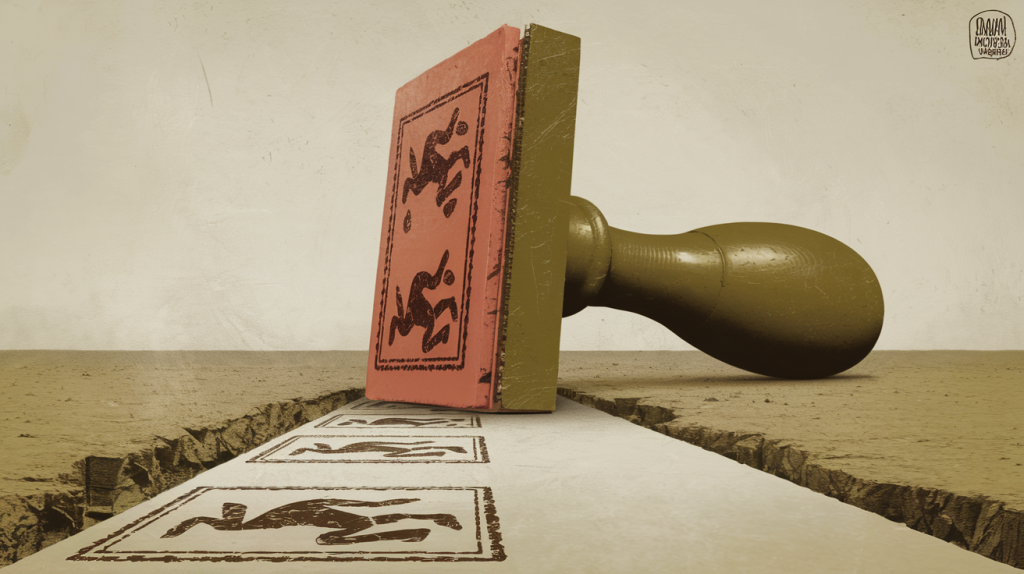

O caso do Sentient Futures mostra, com todas as suas excentricidades e contradições, que a corrida da inteligência artificial não se resume a geopolítica, mercado ou produtividade. Ela também é uma corrida para inscrever em códigos, modelos e sistemas uma determinada ideia de bem, de sofrimento e de proteção.

Hoje, esse grupo escolheu os animais como prioridade. Amanhã, outros atores podem tentar fazer o mesmo em nome de interesses nacionais, crenças religiosas, agendas corporativas ou projetos de controle social.

O ponto central é que essa disputa já está em curso, longe do debate público mais visível e muito além dos parlamentos. Ela acontece em empresas privadas, em redes de financiamento e em círculos intelectuais que operam com recursos comparáveis aos de países inteiros.

Por isso, a pergunta mais importante talvez não seja se esse movimento está certo em querer ensinar compaixão às máquinas. A pergunta decisiva é quem mais está tentando ensinar alguma coisa a elas, com que dinheiro, com quais valores e sem qual escrutínio público.

O Brasil e o Sul Global não podem entrar nessa conversa apenas quando as regras já estiverem escritas por outros. Se a ética da inteligência artificial será moldada por quem pesquisa, financia e propõe alternativas concretas, então ficar de fora dessa etapa significa aceitar, por omissão, valores definidos em outro lugar.

O grupo que se reuniu descalço para discutir ratos, camarões e chatbots entendeu uma verdade estratégica do nosso tempo. Quem disputar a imaginação moral das máquinas disputará também, em alguma medida, o desenho do mundo que elas ajudarão a governar.

Nenhum comentário ainda, seja o primeiro!