O escândalo da Superhuman mostra como a corrida pela inteligência artificial transforma identidade, reputação e trabalho humano em insumo privado sem consentimento.

O CEO da empresa que controla o Grammarly foi confrontado publicamente após vir à tona que sua companhia clonou digitalmente jornalistas e especialistas sem autorização.

A revelação expôs, de forma crua, o método de parte do Vale do Silício na corrida pela inteligência artificial generativa: capturar trabalho humano, empacotar prestígio alheio e vender tudo como inovação.

O episódio ganhou força depois de uma entrevista tensa de Shishir Mehrotra ao podcast Decoder, do site The Verge.

Mehrotra é CEO da Superhuman, holding que controla o corretor gramatical Grammarly, e foi pressionado sobre uma ferramenta lançada em agosto de 2023 chamada Expert Review. O recurso prometia oferecer sugestões de escrita com base em “especialistas” reproduzidos por inteligência artificial.

A controvérsia explodiu quando repórteres do The Verge e de outros veículos descobriram que seus próprios nomes apareciam entre os especialistas usados pela ferramenta. Segundo a apuração, suas identidades e estilos foram aproveitados sem consulta prévia para treinar os modelos.

A jornalista investigativa Julia Angwin reagiu com uma ação coletiva contra a empresa. Primeiro, a resposta da Superhuman foi oferecer um mecanismo complicado de opt-out por e-mail e, depois da pressão pública, desativar completamente a funcionalidade.

No podcast, Mehrotra pediu desculpas publicamente, mas tentou sustentar uma distinção entre “atribuição” e “personificação”. Na prática, essa defesa não eliminou o problema central: profissionais tiveram nome, reputação e trabalho incorporados a um produto sem consentimento.

A entrevista deixa evidente um choque entre duas visões de mundo. De um lado, a empresa trata a ferramenta como extensão natural do avanço tecnológico; de outro, jornalistas e criadores descrevem a experiência como violação, extração e apropriação indevida.

A fala do executivo é especialmente relevante porque ele não é um nome periférico do setor. Mehrotra já foi diretor de produto do YouTube, integra o conselho do Spotify e hoje lidera uma empresa que tenta se posicionar no centro da nova infraestrutura de produtividade baseada em inteligência artificial.

A crise também ocorre em meio a um reposicionamento agressivo da companhia. O grupo trocou o nome corporativo de Grammarly para Superhuman, sinalizando ambições mais amplas do que as de um simples corretor de texto.

Sob essa nova marca, a empresa reúne não apenas o Grammarly, mas também a plataforma de documentos Coda, um cliente de e-mail e uma nova ferramenta chamada Superhuman Go. A proposta é construir um ecossistema em que assistentes de inteligência artificial acompanhem o usuário em praticamente qualquer tarefa digital.

A Superhuman Go é apresentada como uma plataforma capaz de permitir a qualquer pessoa criar “agentes” de inteligência artificial para atuar como assistentes pessoais em qualquer aplicativo. A empresa afirma ter cerca de 40 milhões de usuários ativos diários, o que dá a dimensão do alcance potencial de suas decisões.

O modelo de negócio é claro: tornar a inteligência artificial ubíqua, sempre ao lado do cursor, oferecendo sugestões em serviços como Gmail e Slack sem exigir mudança de comportamento do usuário. A promessa comercial é a de uma assistência constante, invisível e integrada ao fluxo cotidiano de trabalho.

Mas o caso do Expert Review expõe o custo oculto dessa promessa. Para fabricar assistentes supostamente especializados, a empresa recorreu ao trabalho e à identidade pública de profissionais sem compensação e sem autorização.

Esse ponto desloca o debate do campo do constrangimento público para o terreno estrutural. Não se trata apenas de um erro de comunicação ou de uma funcionalidade mal recebida, mas de uma lógica de negócio que transforma prestígio intelectual em matéria-prima extraída unilateralmente.

As questões levantadas são amplas e urgentes. Propriedade intelectual, consentimento, direito de personalidade e remuneração do trabalho cognitivo entram em colisão com plataformas que operam sob a premissa de que tudo o que está acessível pode ser absorvido, processado e monetizado.

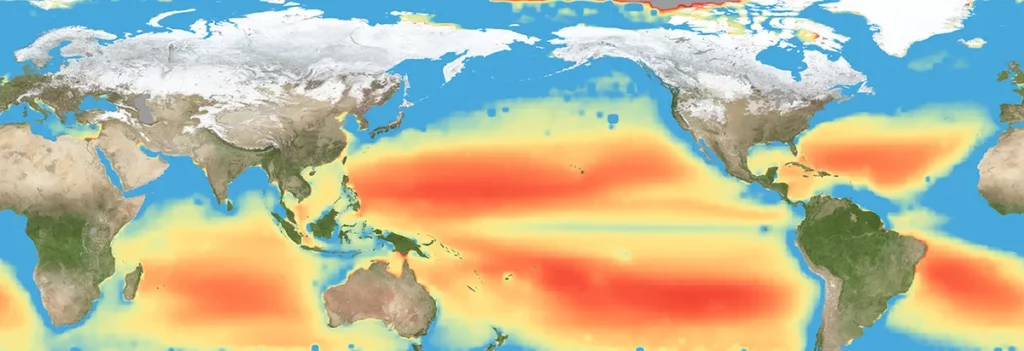

Há, nisso, uma continuidade histórica. Grandes plataformas digitais já construíram fortunas organizando, distribuindo e rentabilizando conteúdo produzido por terceiros; agora, com a inteligência artificial generativa, o passo seguinte é converter esse mesmo conteúdo em voz sintética, estilo replicado e autoridade simulada.

O contraste com outros movimentos regulatórios é inevitável. Enquanto a União Europeia avança com o AI Act para estabelecer limites e obrigações para o setor, casos como o da Superhuman mostram o quanto a autorregulação do Vale do Silício continua insuficiente.

A China, por exemplo, já implementou regras rígidas para deepfakes e síntese de voz, exigindo consentimento claro e rotulagem. No Brasil, o debate sobre um marco legal para inteligência artificial também ganha peso justamente porque episódios assim demonstram que o mercado, sozinho, não protege direitos fundamentais.

A tentativa de Mehrotra de separar “personificação” de “atribuição” soa, nesse contexto, menos como solução e mais como racionalização técnica de uma falha ética básica. Mudar o vocabulário não altera o fato de que pessoas reais foram convertidas em recurso comercial sem que tivessem escolhido participar.

A lição política do caso é direta. A corrida por inovação, quando guiada pela velha doutrina de avançar rápido e corrigir depois, continua tratando seres humanos como bancos de dados ambulantes, prontos para serem minerados por empresas que chamam isso de produto.

Por isso, o episódio vai muito além de uma crise de relações públicas. Ele toca no centro da disputa contemporânea sobre quem captura o valor da revolução da inteligência artificial e quem paga a conta quando identidade, autoria e reputação são apropriadas por sistemas privados.

A ação movida por Julia Angwin pode ser apenas o começo. À medida que empresas aceleram a integração de inteligência artificial em ferramentas de produtividade, os conflitos envolvendo direitos autorais, personalidade, consentimento e remuneração tendem a se multiplicar.

Para o Sul Global, o alerta é ainda mais importante. Nossa produção intelectual, nossa voz e nossa criatividade também estão no radar dessas plataformas, o que torna a soberania tecnológica não apenas uma agenda de desenvolvimento, mas uma questão de defesa cultural, econômica e política.

A ética, nesse cenário, não pode aparecer como remendo tardio, como ocorreu com o opt-out por e-mail oferecido pela empresa depois da denúncia. Se vier só depois do dano, ela deixa de ser princípio e vira protocolo de contenção.

O confronto com o CEO da Superhuman mostrou exatamente isso. Sem regra clara, consentimento prévio e limites reais, a promessa de uma inteligência artificial “super-humana” corre o risco de se sustentar sobre a desumanização silenciosa daqueles cujo trabalho a tornou possível.

Nenhum comentário ainda, seja o primeiro!