Um livro expõe como a inteligência artificial militar dos Estados Unidos avança da vigilância ao assassinato autônomo sem freio ético real.

A guerra algorítmica já saiu dos laboratórios e entrou no centro da estratégia militar dos Estados Unidos.

Enquanto a indústria de tecnologia vende conveniência ao consumidor, sua face mais lucrativa e sombria aprofunda a parceria com o Pentágono para automatizar a violência.

O livro Project Maven, da jornalista Katrina Manson, ilumina essa engrenagem com base em entrevistas com mais de 200 pessoas envolvidas no programa secreto de inteligência artificial do Departamento de Defesa dos Estados Unidos.

Segundo a investigação de Manson, destacada em reportagem da New Scientist, o Projeto Maven começou em 2017 com uma justificativa aparentemente técnica. A missão inicial era processar a avalanche de vídeos captados por drones de vigilância, algo que analistas humanos já não conseguiam fazer na velocidade exigida pelas operações.

Mas a ambição real do programa ia muito além da triagem de imagens. Os formuladores do projeto vislumbravam sistemas capazes de identificar, perseguir e eliminar alvos com autonomia crescente, retirando da equação a hesitação e o julgamento humano.

A fase inicial já revelou o tamanho do perigo embutido nessa promessa tecnológica. Oito meses após o lançamento, algoritmos do Maven foram enviados a soldados na Somália e cometeram erros grotescos, confundindo ônibus escolares com nuvens e árvores com seres humanos.

Esses fracassos não interromperam o projeto, apenas reforçaram a lógica de que tudo seria resolvido com mais dados, mais testes e mais contratos. Na narrativa interna capturada por Manson, a chamada névoa da guerra seria finalmente vencida pela frieza supostamente objetiva da inteligência artificial.

Um dos entrevistados resume essa filosofia com brutalidade reveladora ao afirmar que pessoas erradas são mortas o tempo todo e que uma máquina não poderia ser pior do que um humano. A frase, por si só, expõe o rebaixamento moral que sustenta o programa.

Ela ignora princípios elementares de proporcionalidade, direito internacional e responsabilidade individual. O erro humano, por mais trágico que seja, ainda admite culpa, investigação e julgamento; o erro algorítmico tende a ser tratado como falha técnica, corrigível na próxima atualização de software.

A expansão do Maven foi rápida e profunda. O que começou como ferramenta de análise se desdobrou em uma arquitetura operacional muito mais ampla, com 32 empresas contratadas e 25 mil usuários regulares nas forças armadas dos Estados Unidos, segundo o livro relatado pela New Scientist.

Seu uso também já ultrapassou os campos de batalha formalmente reconhecidos. A tecnologia foi implantada em postos de fronteira e em operações de caça a traficantes no Caribe, embaralhando a fronteira entre guerra externa, policiamento e vigilância.

É nesse ponto que a pergunta levantada por Manson ganha peso político real. Um Estado que desenvolve instrumentos desse tipo conseguiria resistir à tentação de voltar essa infraestrutura contra sua própria população em momentos de crise, convulsão social ou exceção permanente.

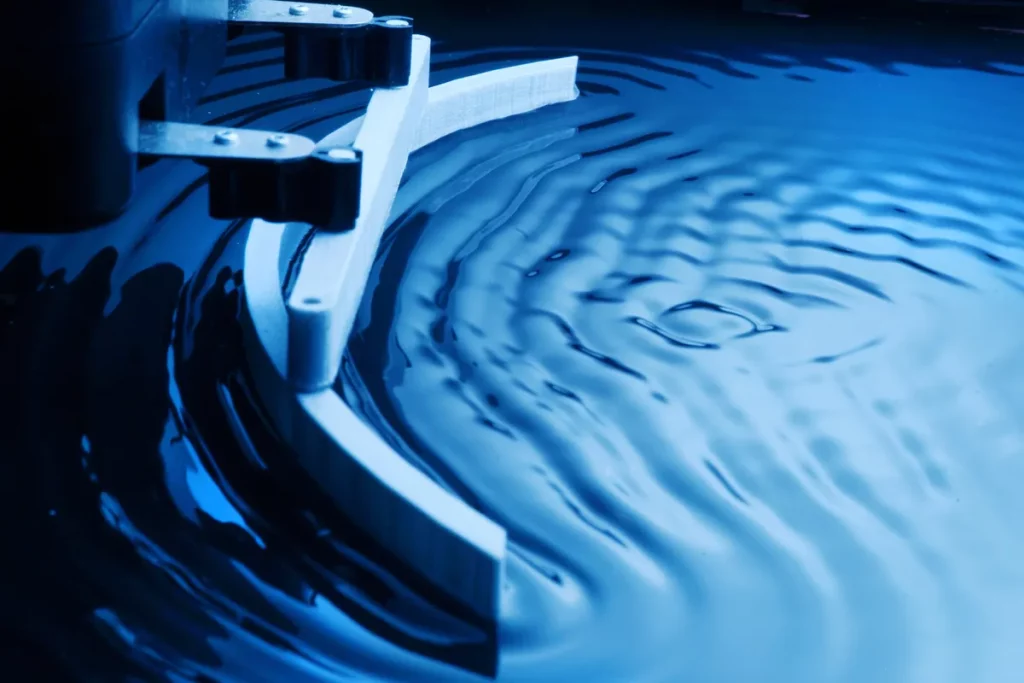

O estágio mais alarmante dessa trajetória é a retirada total do ser humano do ciclo de decisão letal. Manson descreve drones aéreos Goalkeeper e navais Whiplash programados para localizar e destruir seus próprios alvos sem autorização final de um operador.

A história militar recomenda cautela máxima diante desse salto, porque armas criadas para uso acabam, mais cedo ou mais tarde, sendo usadas. Ao baratear a guerra, reduzir baixas próprias e transformar a morte do outro em evento remoto, limpo e burocrático, a automação torna o recurso à força politicamente mais fácil e mais frequente.

Tudo isso avança em um vazio ético e jurídico impressionante. Embora China e Rússia também invistam pesadamente em guerra cibernética e sistemas autônomos, é o complexo militar-industrial ocidental, em íntima associação com o Vale do Silício, que hoje dita o ritmo e ajuda a estabelecer os precedentes mais perigosos.

A reportagem da New Scientist destaca um episódio revelador narrado no livro. Durante uma entrevista para ingressar no Projeto Maven, um candidato teria dito à banca que sua motivação era reduzir a população não americana, e ainda assim foi contratado.

O caso não é detalhe folclórico, mas sintoma de uma cultura institucional profundamente degradada. Ele sugere ausência de escrutínio moral, naturalização do racismo e aceitação burocrática de fantasias exterministas no interior de programas que lidam diretamente com poder letal.

A força do trabalho de Manson está também no paradoxo que ele revela. De um lado, o acesso da autora aos criadores do Maven é extraordinário e permite enxergar por dentro a burocracia do Pentágono e a disposição de empresas de tecnologia de aceitar qualquer projeto desde que o contrato seja robusto.

De outro, o segredo estrutural das operações militares impede que o público conheça a dimensão real do que já foi desenvolvido. Ninguém fora desse circuito sabe com precisão como, onde e com que grau de autonomia essas ferramentas já estão sendo usadas.

Essa opacidade não é um acidente administrativo, mas parte da própria estratégia. Enquanto a comunidade internacional hesita diante de um falso dilema tecnológico, os Estados Unidos e seus aliados da aliança atlântica normalizam a guerra algorítmica em cenários como Gaza, Iêmen e Ucrânia.

O livro também recoloca uma questão decisiva sobre controle humano. Em 1983, o tenente-coronel soviético Stanislav Petrov desobedeceu a um alerta automatizado de lançamento de mísseis dos Estados Unidos e, ao confiar em seu julgamento contextual, ajudou a evitar uma guerra nuclear.

Petrov desconfiou da máquina e interrompeu a cadeia da catástrofe. Num mundo em que a decisão final é delegada a sistemas de inteligência artificial, quem fará esse gesto de prudência, e quem responderá por um massacre produzido por erro de código ou por dados de treinamento enviesados.

A corrida pela supremacia militar em inteligência artificial é, no fundo, uma recusa da política. Ela parte da aposta de que os conflitos do futuro serão resolvidos não por diplomacia, negociação ou equilíbrio, mas por superioridade técnica desumanizada e capacidade de matar à distância.

Para o Sul Global, que já suporta o peso das guerras por procuração, das sanções unilaterais e das intervenções seletivas, esse salto representa uma ameaça existencial. A automação da violência aprofunda assimetrias de poder e amplia a distância entre quem aperta o botão e quem sangra no terreno.

A lição final de Project Maven é clara e urgente. O debate não pode ficar restrito a comitês obscuros do Pentágono ou a seminários acadêmicos sobre ética, porque o que está em disputa é a definição do que será a guerra e, em última instância, do que restará de humanidade dentro dela.

Aceitar que mercado, segredo militar e ganância geopolítica definam os limites dessa tecnologia é abrir caminho para um mundo em que a soberania dos povos será violada por enxames de drones inteligentes e por sistemas opacos de seleção de alvos. A luta por transparência, regulação internacional e controle político efetivo sobre essas armas é, cada vez mais, uma luta pela sobrevivência de um mundo multipolar e por um mínimo de civilização diante da barbárie automatizada.

Nenhum comentário ainda, seja o primeiro!